세계 최초 AI 벡터DB 칩 만든 디노티시아

AI에 필수적인 최신 정보들… 빠르게 처리하는 DB기술 개발

저전력 고효율 위해 칩으로 구현… “AI 데이터센터 비용 80% 절감”

반도체-AI 20년 연구가 밑바탕… “장기 기억 갖춘 AI 시대 열 것”

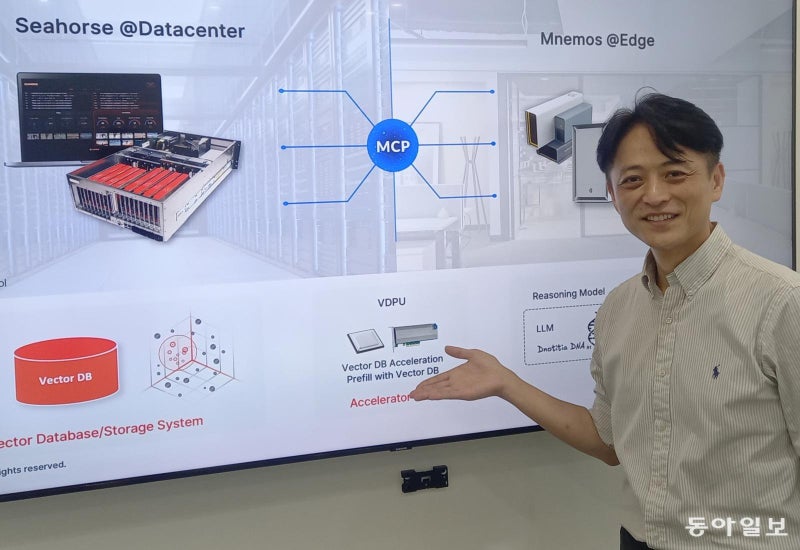

정무경 디노티시아 대표이사가 지난달 28일 서울 서초구 사무실에서 자사의 벡터 DB 기술과 칩의 성능에 대해 설명하고 있다. 그는 “데이터 참조 방식이 획기적으로 개선돼 뛰어난 성능의 AI가 실현되고 있다”고 했다.대형언어모델(LLM) 인공지능(AI)이 더 활발히 쓰이기 시작한 건 답변에 최신 정보가 반영되면서부터다. 2023년 3월에 나온 오픈AI의 GPT4와 빙 검색이 결합된 마이크로소프트 코파일럿이 시초로 꼽힌다. 이전에는 ‘현직 미국 대통령이 누구야?’라고 물으면 LLM이 학습한 자료가 1∼2년 전 것이어서 옛 시점을 기준으로 잘못된 대답을 내놓곤 했다. 코파일럿에는 외부 지식을 참조해서 답변하는 검색증강생성(RAG·래그) 기술이 적용됐다. 검색한 최신 자료를 보강해서 답변을 생성한다는 의미다.

디노티시아는 검색증강생성이 더 정확하고 빠르게 작동할 수 있도록 해 주는 기술을 가진 스타트업이다. LLM이 좋은 답변을 생성할 수 있도록 사용자의 질문 의도에 맞는 양질의 데이터를 빠르게 검색해 투입하는 기술이다. 여기에 벡터 데이터베이스(DB)가 쓰이는데, 세계에서 처음으로 벡터DB 검색 기술을 칩으로 구현했다. 하드웨어 칩은 소프트웨어 보다 훨씬 빠르고 경제적이다.

지난달 28일 서울 서초구 사무실에서 만난 정무경 디노티시아 대표이사(49)는 “실리콘밸리의 많은 벡터DB 회사들이 소프트웨어 위주로 자료를 처리하는 데 우리가 유일하게 전용 칩을 만들었다”며 “속도는 10배 더 빨라지고 데이터센터 비용은 80%나 절감할 수 있다”고 했다.

● “AI 시대, 벡터 기반 데이터 처리가 관건”

컴퓨터는 단어나 이미지를 그대로 이해하지 못한다. 그래서 사용하는 대표적인 방식이 단어와 이미지를 좌표(벡터)로 바꿔서 활용하는 것이다. ‘고양이’를 [0.8, 0.3, 0.5], ‘강아지’를 [0.7, 0.4, 0.6]으로 변환하는 식이다. 목적에 맞게 잘 배치하는 게 기술이다. 이 경우 고양이와 강아지는 3차원에서 상대적으로 가까운 곳에 있다. 컴퓨터는 벡터의 방향이 비슷하고, 거리가 가까우면 의미가 비슷하다고 여긴다. ‘포유류’라는 단어도 상대적으로 고양이와 강아지와 가까이 곳에 배치된다. 이렇게 데이터를 벡터 기반으로 관리하는 것이 벡터 DB다. 실제 쓰이는 벡터는 3차원이 아니라 수천 차원까지 올라간다. 벡터의 방향과 거리를 계산하는 데는 수천억 번의 연산이 필요하다.

사용자가 ‘최근에 발견된 포유류를 알려줘’라고 질문하면 검색증강생성 과정이 시작되면서 벡터DB는 포유류 좌표와 가까이 있는 정보들을 결과로 내놓고, LLM은 이 내용을 기반으로 답변을 생성한다. 검색 결과가 좋아야 좋은 답변이 나오는 것이다.

● 서버 10대 일을 1대로 끝내

컴퓨터 장치에는 역할 분담이 있다. 중앙처리장치(CPU)는 총감독, 그래픽처리장치(GPU)와 신경망처리장치(NPU)는 AI 추론 전문가다. 그런데 ‘벡터 검색’ 전문가는 없었다. 디노티시아가 벡터DB 칩인 벡터데이터처리장치(VDPU·Vector Data Processing Unit)를 만들기 전까지 그랬다.

디노티시아에 따르면 비용 대비 검색 성능은 CPU에 비해 10배, GPU 대비로도 10배 이상 좋다. 전력도 적게 든다. 데이터센터 총소유비용(TCO)비용을 80%나 절감할 수 있고, 데이터센터 공간도 크게 줄일 수 있다. 정 대표는 “서버 10대 필요하던 일을 거의 1대로 끝낼 수 있는 수준”이라며 “AI를 제대로 쓸 수 있는 기업과 없는 기업을 가르던 비용 장벽을 허무는 데 기여할 것”이라고 했다.

디노티시아는 현재 벡터DB칩을 시제품 성격인 프로그래머블 반도체(FPGA)로 검증을 하고 있다. 2026년 하반기 주문형반도체(ASIC)칩으로 공개할 계획이다. 반도체 디자인하우스 에이직랜드와 개발 계약을 맺었고, 양산은 TSMC에서 할 예정이다. 클라우드 업체, 데이터 스토리지 업체 등이 고객이다.

● 반도체·DB·AI 전문가들이 합심

딥러닝 방식에 의한 인공지능의 실현 가능성을 보인 사건은 2012년 이미지 인식대회인 이미지넷에서 ‘알렉스넷’이라는 딥러닝 모델이 1위를 했을 때다. 2006년 KAIST에서 반도체로 박사학위를 받은 정 대표는 당시 삼성전자 종합기술원에서 GPU를 개발하고 있었다. 그는 알렉스넷의 등장을 보고 “이거(딥러닝) 진짜 될 것 같다”고 느꼈다.

2015년 SK텔레콤으로 옮기며 기회를 만들었다. 연구과제를 비교적 자유롭게 선택할 수 있었던 것이다. 그는 데이터베이스, GPU 클라우드, AI 반도체를 동시에 연구하고 개발했다. 2017년 팀장이 돼 NPU 프로젝트 ‘사피온’을 시작했고, 2020년 국내 최초 데이터센터용 NPU 칩을 상용화했다.

그러다가 딥러닝 모델이 활용하는 데이터 규모가 커지고 벡터 기반 검색의 중요성이 빠르게 높아지는 것을 느꼈다. 기존 NPU와는 별개의 영역인 벡터 연산 전용 하드웨어가 필요하다는 판단에서 창업을 결심했다.

2023년 디노티시아가 문을 열었다. 삼성에서 익힌 반도체 설계, SK에서 축적한 데이터베이스와 AI 인프라 등 약 20년 경험이 모두 합쳐졌다. 벡터DB 가속 칩을 만들려면 반도체와 데이터베이스, AI를 모두 알아야 한다. 디노티시아로 이런 인재들을 모았다.

올해 4월 디노티시아는 설립 22개월 만에 CB인사이트 ‘AI 100’에 이름을 올렸다. 전 세계에서 혁신적인 AI 기업 100곳을 뽑은 목록이다. 올해 처음 생긴 ‘벡터 데이터베이스’ 부문에서 독일의 한 회사와 함께 선정됐다.

● 한국어로 생각하는 AI, 책상 위 개인 비서까지

올해 6월 서울 코엑스에서 열린 넥스트라이즈 전시회에서 양세현 디노티시아 최고기술책임자(CTO)가 부스 방문객들에게 자사 기술을 설명하고 있다. 디노티시아 제공디노티시아는 벡터DB 기술을 바탕으로 다양한 분야를 노리고 있다. 2024년 12월 한국어 처리에 특화된 AI 모델 ‘DNA’를 오픈소스로 공개했다.이 모델은 당시 한국어 전문 지식 평가에서는 LG엑사원을 제치고 1위에 올랐다. 올해 3월엔 한국어 논리 추론 특화 ‘DNA-R1’도 발표했다. 국내 최초로 추론 과정 전체가 한국어로 이뤄지는 모델이어서 한국어 특유의 미묘한 맥락을 잘 이해한다는 것이 회사 측 설명이다.

올해 벡터 DB 솔루션 ‘씨홀스 클라우드’를 서비스형 소프트웨어(SaaS) 형태로 선보였다. 브라우저 기반이라 별도의 설치 없이 벡터 DB를 구축하고 운영할 수 있으며, 클라우드 환경에서 벡터DB, RAG, AI 에이전트를 통합적으로 제공하는 것이 특징이다.

2025년 미국 소비자가젼쇼(CES) 전시된 AI 워크스테이션 ‘니모스’. 클라우드 연결없이 AI 서비스를 가능케 해 준다. 디노티시아 제공8월에는 클라우드 연결이 필요 없는 AI 디바이스 ‘니모스 워크스테이션’을 출시했다. 회사 기밀을 외부로 보낼 수 없는 금융·의료·국방 등 데이터 보안 요구가 높은 분야에서 활용도가 높다. ‘니모스 워크스테이션’에는 스토리지, GPU, DNA 모델, 벡터 DB 씨홀스와 AI 에이전트 기능이 하나의 장비로 통합돼 있다. 기존처럼 복잡한 AI 인프라를 따로 구축하지 않아도, 단일 워크스테이션에서 고성능 연산과 통합 소프트웨어를 기반으로 고도화된 AI 작업을 실시간으로 처리할 수 있는 구조다.

정 대표는 “AI 기술 발전은 이제 모델 크기가 아니라 데이터 검색의 정밀도와 추론 최적화로 중심축이 이동하고 있다”며 “AI가 데이터에서 정확한 정보를 효율적으로 참조할 수 있으면 장기 기억을 가진 사람처럼 응답하게 되는데, 이런 시대를 앞당길 것”이라고 했다.

AI에 필수적인 최신 정보들… 빠르게 처리하는 DB기술 개발

저전력 고효율 위해 칩으로 구현… “AI 데이터센터 비용 80% 절감”

반도체-AI 20년 연구가 밑바탕… “장기 기억 갖춘 AI 시대 열 것”

디노티시아는 검색증강생성이 더 정확하고 빠르게 작동할 수 있도록 해 주는 기술을 가진 스타트업이다. LLM이 좋은 답변을 생성할 수 있도록 사용자의 질문 의도에 맞는 양질의 데이터를 빠르게 검색해 투입하는 기술이다. 여기에 벡터 데이터베이스(DB)가 쓰이는데, 세계에서 처음으로 벡터DB 검색 기술을 칩으로 구현했다. 하드웨어 칩은 소프트웨어 보다 훨씬 빠르고 경제적이다.

지난달 28일 서울 서초구 사무실에서 만난 정무경 디노티시아 대표이사(49)는 “실리콘밸리의 많은 벡터DB 회사들이 소프트웨어 위주로 자료를 처리하는 데 우리가 유일하게 전용 칩을 만들었다”며 “속도는 10배 더 빨라지고 데이터센터 비용은 80%나 절감할 수 있다”고 했다.

● “AI 시대, 벡터 기반 데이터 처리가 관건”

컴퓨터는 단어나 이미지를 그대로 이해하지 못한다. 그래서 사용하는 대표적인 방식이 단어와 이미지를 좌표(벡터)로 바꿔서 활용하는 것이다. ‘고양이’를 [0.8, 0.3, 0.5], ‘강아지’를 [0.7, 0.4, 0.6]으로 변환하는 식이다. 목적에 맞게 잘 배치하는 게 기술이다. 이 경우 고양이와 강아지는 3차원에서 상대적으로 가까운 곳에 있다. 컴퓨터는 벡터의 방향이 비슷하고, 거리가 가까우면 의미가 비슷하다고 여긴다. ‘포유류’라는 단어도 상대적으로 고양이와 강아지와 가까이 곳에 배치된다. 이렇게 데이터를 벡터 기반으로 관리하는 것이 벡터 DB다. 실제 쓰이는 벡터는 3차원이 아니라 수천 차원까지 올라간다. 벡터의 방향과 거리를 계산하는 데는 수천억 번의 연산이 필요하다.

사용자가 ‘최근에 발견된 포유류를 알려줘’라고 질문하면 검색증강생성 과정이 시작되면서 벡터DB는 포유류 좌표와 가까이 있는 정보들을 결과로 내놓고, LLM은 이 내용을 기반으로 답변을 생성한다. 검색 결과가 좋아야 좋은 답변이 나오는 것이다.

● 서버 10대 일을 1대로 끝내

컴퓨터 장치에는 역할 분담이 있다. 중앙처리장치(CPU)는 총감독, 그래픽처리장치(GPU)와 신경망처리장치(NPU)는 AI 추론 전문가다. 그런데 ‘벡터 검색’ 전문가는 없었다. 디노티시아가 벡터DB 칩인 벡터데이터처리장치(VDPU·Vector Data Processing Unit)를 만들기 전까지 그랬다.

디노티시아에 따르면 비용 대비 검색 성능은 CPU에 비해 10배, GPU 대비로도 10배 이상 좋다. 전력도 적게 든다. 데이터센터 총소유비용(TCO)비용을 80%나 절감할 수 있고, 데이터센터 공간도 크게 줄일 수 있다. 정 대표는 “서버 10대 필요하던 일을 거의 1대로 끝낼 수 있는 수준”이라며 “AI를 제대로 쓸 수 있는 기업과 없는 기업을 가르던 비용 장벽을 허무는 데 기여할 것”이라고 했다.

디노티시아는 현재 벡터DB칩을 시제품 성격인 프로그래머블 반도체(FPGA)로 검증을 하고 있다. 2026년 하반기 주문형반도체(ASIC)칩으로 공개할 계획이다. 반도체 디자인하우스 에이직랜드와 개발 계약을 맺었고, 양산은 TSMC에서 할 예정이다. 클라우드 업체, 데이터 스토리지 업체 등이 고객이다.

● 반도체·DB·AI 전문가들이 합심

딥러닝 방식에 의한 인공지능의 실현 가능성을 보인 사건은 2012년 이미지 인식대회인 이미지넷에서 ‘알렉스넷’이라는 딥러닝 모델이 1위를 했을 때다. 2006년 KAIST에서 반도체로 박사학위를 받은 정 대표는 당시 삼성전자 종합기술원에서 GPU를 개발하고 있었다. 그는 알렉스넷의 등장을 보고 “이거(딥러닝) 진짜 될 것 같다”고 느꼈다.

2015년 SK텔레콤으로 옮기며 기회를 만들었다. 연구과제를 비교적 자유롭게 선택할 수 있었던 것이다. 그는 데이터베이스, GPU 클라우드, AI 반도체를 동시에 연구하고 개발했다. 2017년 팀장이 돼 NPU 프로젝트 ‘사피온’을 시작했고, 2020년 국내 최초 데이터센터용 NPU 칩을 상용화했다.

그러다가 딥러닝 모델이 활용하는 데이터 규모가 커지고 벡터 기반 검색의 중요성이 빠르게 높아지는 것을 느꼈다. 기존 NPU와는 별개의 영역인 벡터 연산 전용 하드웨어가 필요하다는 판단에서 창업을 결심했다.

2023년 디노티시아가 문을 열었다. 삼성에서 익힌 반도체 설계, SK에서 축적한 데이터베이스와 AI 인프라 등 약 20년 경험이 모두 합쳐졌다. 벡터DB 가속 칩을 만들려면 반도체와 데이터베이스, AI를 모두 알아야 한다. 디노티시아로 이런 인재들을 모았다.

올해 4월 디노티시아는 설립 22개월 만에 CB인사이트 ‘AI 100’에 이름을 올렸다. 전 세계에서 혁신적인 AI 기업 100곳을 뽑은 목록이다. 올해 처음 생긴 ‘벡터 데이터베이스’ 부문에서 독일의 한 회사와 함께 선정됐다.

● 한국어로 생각하는 AI, 책상 위 개인 비서까지

올해 벡터 DB 솔루션 ‘씨홀스 클라우드’를 서비스형 소프트웨어(SaaS) 형태로 선보였다. 브라우저 기반이라 별도의 설치 없이 벡터 DB를 구축하고 운영할 수 있으며, 클라우드 환경에서 벡터DB, RAG, AI 에이전트를 통합적으로 제공하는 것이 특징이다.

정 대표는 “AI 기술 발전은 이제 모델 크기가 아니라 데이터 검색의 정밀도와 추론 최적화로 중심축이 이동하고 있다”며 “AI가 데이터에서 정확한 정보를 효율적으로 참조할 수 있으면 장기 기억을 가진 사람처럼 응답하게 되는데, 이런 시대를 앞당길 것”이라고 했다.

댓글목록

등록된 댓글이 없습니다.